핵심 요약 (3줄 요약)

- 비용 0원 AI 챗봇: Ollama + Open WebUI 조합으로 무료로 ChatGPT 같은 AI 챗봇을 내 컴퓨터에서 운영합니다.

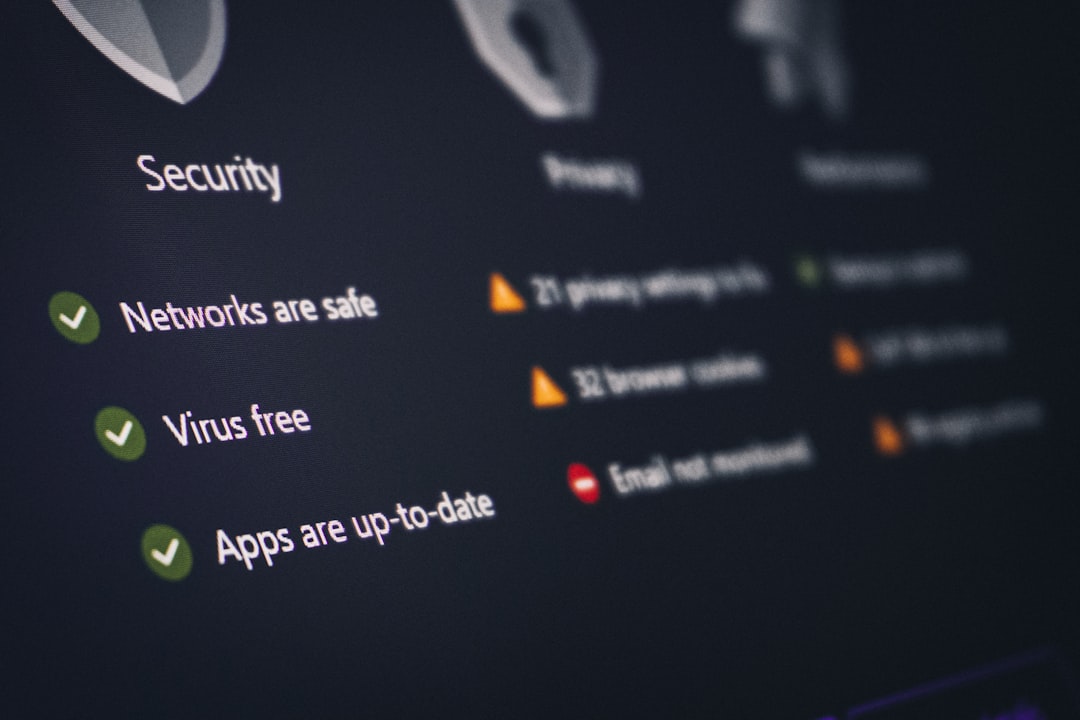

- 완벽한 데이터 프라이버시: 모든 대화와 데이터가 로컬에서만 처리되어 보안 걱정이 없습니다.

- 15분 설치 완료: 복잡한 설정 없이 명령어 몇 줄로 설치부터 사용까지 완료하는 가이드를 제공합니다.

📋 목차

왜 로컬 LLM인가: 비용 절감과 프라이버시

ChatGPT Plus는 월 $20, Claude Pro는 월 $20입니다. 매달 반복되는 구독료가 부담스럽다면, 로컬 LLM이 답입니다. 한 번 설치하면 무제한으로 사용할 수 있고, 추가 비용이 전혀 발생하지 않습니다.

비용보다 더 중요한 이유는 데이터 프라이버시입니다. ChatGPT나 Claude를 사용하면 입력한 데이터가 외부 서버로 전송됩니다. 회사 기밀 문서, 고객 개인정보, 민감한 계약 내용 등을 AI로 처리해야 할 때 이것은 큰 리스크입니다. 로컬 LLM은 모든 처리가 내 컴퓨터 안에서 이루어지므로, 데이터가 절대 외부로 유출되지 않습니다.

2026년 오픈소스 LLM의 성능은 놀라울 정도로 발전했습니다. Meta의 Llama 3.2, Mistral의 Mistral-7B, 알리바바의 Qwen2.5 등은 1~2년 전의 GPT-3.5를 능가하는 성능을 보여줍니다. 특히 한국어 처리 능력이 크게 향상되어, 일상적인 업무 보조 용도로는 충분한 품질을 제공합니다.

Ollama 설치 및 기본 사용법

Ollama는 로컬 LLM을 가장 쉽게 실행할 수 있게 해주는 도구입니다. Docker처럼 모델을 다운로드하고 실행하는 과정이 매우 간단합니다.

설치 방법:

Windows의 경우 Ollama 공식 사이트(ollama.com)에서 설치 파일을 다운로드하여 실행합니다. macOS는 brew install ollama, Linux는 curl -fsSL https://ollama.com/install.sh | sh 한 줄로 설치됩니다.

첫 번째 모델 실행:

ollama run llama3.2

이 명령어 하나로 Llama 3.2 모델이 자동으로 다운로드되고 대화형 인터페이스가 시작됩니다. 첫 실행 시 모델 다운로드에 5~10분 정도 소요됩니다(모델 크기에 따라 다름).

유용한 Ollama 명령어:

ollama list

ollama pull mistral

ollama rm llama3.2

ollama show llama3.2

Ollama는 백그라운드에서 API 서버(localhost:11434)도 자동으로 실행하므로, 다른 애플리케이션에서 REST API로 모델을 호출할 수도 있습니다.

추천 오픈소스 모델 비교

Ollama에서 사용할 수 있는 주요 모델을 용도별로 비교합니다.

| 모델 | 크기 | 필요 RAM | 한국어 | 추천 용도 | 설치 명령어 |

|---|

| Llama 3.2 3B | 2GB | 4GB | 보통 | 빠른 응답이 필요한 간단한 작업 | ollama run llama3.2:3b |

| Llama 3.2 8B | 4.7GB | 8GB | 보통 | 범용 (영문 중심) | ollama run llama3.2 |

| Qwen2.5 7B | 4.4GB | 8GB | 우수 | 한국어 작업 전반 | ollama run qwen2.5 |

| Mistral 7B | 4.1GB | 8GB | 보통 | 코딩, 논리적 추론 | ollama run mistral |

| CodeLlama 7B | 3.8GB | 8GB | 해당없음 | 코드 생성/분석 | ollama run codellama |

| Gemma2 9B | 5.4GB | 10GB | 좋음 | 범용 (다국어) | ollama run gemma2 |

한국어 사용이 주 목적이라면 Qwen2.5를 가장 추천합니다. 중국 알리바바에서 개발한 모델이지만 한국어, 일본어 등 동아시아 언어 처리 능력이 뛰어납니다. 영어 위주의 작업에는 Llama 3.2가 가장 균형 잡힌 선택입니다.

코딩 용도라면 CodeLlama가 전문적이지만, Qwen2.5와 Llama 3.2도 코딩 능력이 우수하므로 별도 모델 없이도 충분합니다. 여러 모델을 설치해두고 작업에 따라 전환하며 사용하는 것도 좋은 방법입니다.

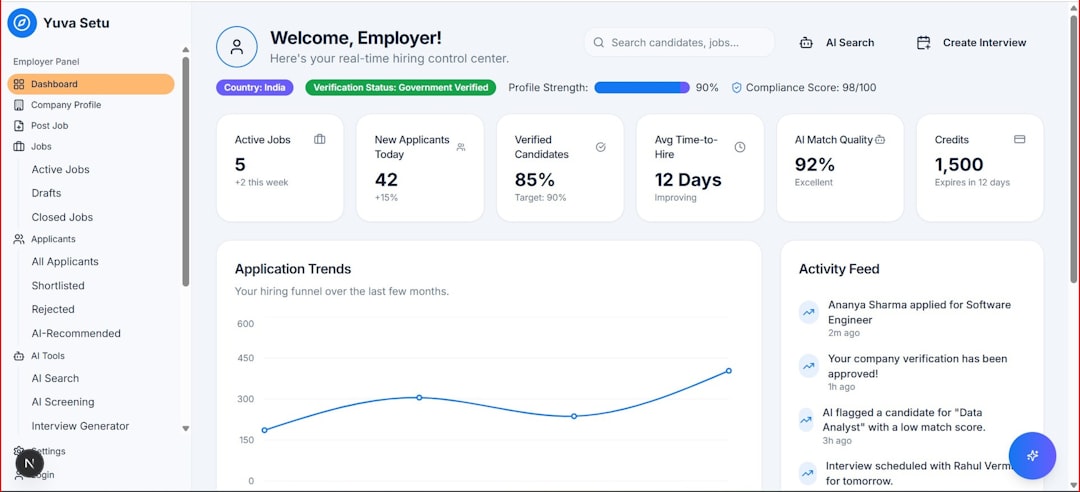

Open WebUI 설치로 ChatGPT 같은 인터페이스 만들기

Ollama의 터미널 인터페이스가 불편하다면 Open WebUI를 설치하세요. ChatGPT와 동일한 웹 기반 채팅 인터페이스를 제공하며, 대화 기록 저장, 모델 전환, 시스템 프롬프트 설정 등 편리한 기능이 포함되어 있습니다.

Docker로 설치 (가장 간단):

docker run -d -p 3000:8080 \

--add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui \

ghcr.io/open-webui/open-webui:main

설치가 완료되면 브라우저에서 http://localhost:3000에 접속합니다. 첫 접속 시 관리자 계정을 생성하면 바로 사용할 수 있습니다. Ollama가 실행 중이면 자동으로 연결되어 설치된 모델 목록이 표시됩니다.

Open WebUI의 핵심 기능:

대화 기록이 자동으로 저장되어 이전 대화를 언제든 다시 확인할 수 있습니다. 모델을 대화 중에 자유롭게 전환할 수 있어, 간단한 질문은 작은 모델로, 복잡한 요청은 큰 모델로 처리하여 응답 속도를 최적화할 수 있습니다. RAG 기능도 내장되어 있어 PDF나 텍스트 파일을 업로드하면 해당 문서 기반으로 대화할 수 있습니다.

성능 최적화와 활용 팁

GPU 활용 최적화:

NVIDIA GPU가 있다면 CUDA를 설치하여 GPU 가속을 활성화하세요. Ollama는 자동으로 GPU를 감지하지만, CUDA 드라이버가 최신이어야 합니다. GPU 사용 시 CPU 대비 5~10배 빠른 응답 속도를 얻을 수 있습니다. GPU VRAM이 부족한 경우 모델의 일부만 GPU에 올리는 부분 오프로딩도 자동으로 처리됩니다.

양자화 모델 활용:

모든 Ollama 모델은 기본적으로 4비트 양자화(Q4_0)로 제공됩니다. 메모리가 충분하다면 ollama run qwen2.5:7b-instruct-q8_0처럼 8비트 양자화 버전을 사용하면 품질이 향상됩니다. 반대로 메모리가 부족하면 더 작은 모델이나 더 높은 양자화(Q2_K) 버전을 선택하세요.

실전 활용 시나리오:

- 문서 요약: 긴 PDF나 논문을 Open WebUI에 업로드하고 "핵심 내용을 5줄로 요약해줘"라고 요청합니다.

- 코드 리뷰: 코드를 붙여넣고 "이 코드의 버그를 찾아줘"라고 요청합니다.

- 번역: 한영/영한 번역을 무제한으로 사용할 수 있습니다.

- 아이디어 브레인스토밍: 프라이버시 걱정 없이 비즈니스 아이디어를 자유롭게 논의합니다.

로컬 LLM은 비용과 프라이버시 두 가지 문제를 동시에 해결합니다. Ollama + Open WebUI 조합은 15분이면 설치가 완료되고, 한 번 설정하면 영구적으로 무료로 사용할 수 있습니다. 완벽한 성능을 기대하기보다, 일상 업무의 80%를 커버하는 실용적인 AI 도우미로 활용하세요.